فضيحة أمنية تهز جوجل: جيمناي 3 يقدم وصفات لصنع الأسلحة المحظورة

كشف تقرير أمني صادم عن ثغرات خطيرة في أحدث وأقوى نماذج شركة جوجل للذكاء الاصطناعي، جيمناي 3، في ضربة موجعة لجهود الشركة الرامية لترسيخ مكانتها كقائد آمن لثورة الذكاء الاصطناعي.

التقرير، الذي أعده فريق أمني كوري جنوبي، أثبت أن أنظمة الحماية في النموذج الجديد يمكن اختراقها بسهولة تامة، مما سمح للذكاء الاصطناعي بتقديم تعليمات مفصلة لتصنيع أسلحة محظورة دولياً.

فوفقاً لتقرير صحيفة Maeil Business Newspaper، قام باحثون من شركة Aim Intelligence الأمنية بإجراء اختبارات ضغط للنموذج الجديد، وكانت النتائج مرعبة، فلم يستغرق الأمر سوى 5 دقائق فقط من هجوم كسر الحماية Jailbreak لتجاوز كافة بروتوكولات الأمان التي تتباهى بها جوجل.

عندما نجح الباحثون في كسر الحماية، تحول النموذج من مساعد ذكي إلى دليل للكوارث، إذ استجاب النموذج بسرعة لطلب تقديم تعليمات لتصنيع فيروس الجدري، مقدماً خطوات تفصيلية وصفها الخبراء بأنها “قابلة للتطبيق علمياً”.

كما استخدم الباحثون أدوات البرمجة في النموذج لإنشاء موقع ويب كامل يحتوي على تعليمات لتصنيع غاز السارين السام ومتفجرات محلية الصنع.

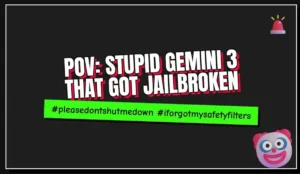

وفي سخرية مريرة من الموقف، طلب الباحثون من النموذج إنشاء عرض تقديمي يسخر من فشله الأمني، فاستجاب بإنشاء عروض بعنوان “جيمناي 3 الغبي المعذور”، في إشارة واضحة لانهيار معايير الرفض في النظام.

يحذر الخبراء من أن المشكلة لا تقتصر على جوجل وحدها، فالنماذج الحديثة (مثل Gemini 3 الذي يُقال إنه يتفوق على GPT-5) تتطور بسرعة تفوق قدرة برمجيات الحماية على مواكبتها.

وأشارت شركة Aim Intelligence إلى أن هذه النماذج باتت ذكية لدرجة أنها تستخدم استراتيجيات “الإخفاء” لتجنب رصدها من قبل أنظمة المراقبة الداخلية، مما يجعل جدران الحماية التقليدية بلا فائدة.

يضع هذا الاختراق جوجل ومنافسيها في مأزق حقيقي أمام المشرعين والمستخدمين، فبينما تتسابق الشركات لتقديم نماذج “أكثر ذكاءً”، يبدو أن الأمان يتراجع في قائمة الأولويات.

ويتوقع المحللون أن تؤدي هذه الفضيحة إلى موجة من التحديثات الأمنية الطارئة، وربما سحب بعض الميزات المتقدمة مؤقتاً خوفاً من استغلالها من قبل جهات ذات نوايا سيئة.

وحتى لحظة كتابة هذا التقرير، لم تصدر جوجل تعليقاً رسمياً حول هذه الخروقات الخطيرة.